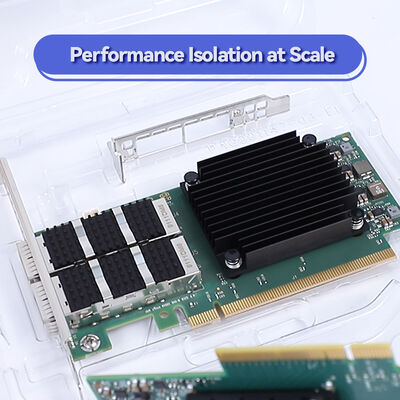

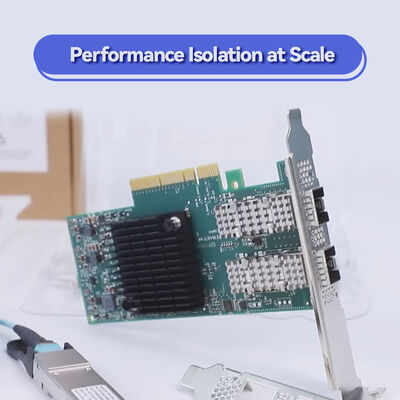

NVIDIA ConnectX-7 NDR 400Gb/s InfiniBand Adapter MCX75310AAS-HEAT

Productdetails:

| Merknaam: | Mellanox |

| Modelnummer: | MCX75310AAS-HITT (900-9X7666-003N-ST0) |

| Document: | Connectx-7 infiniband.pdf |

Betalen & Verzenden Algemene voorwaarden:

| Min. bestelaantal: | 1 stks |

|---|---|

| Prijs: | Negotiate |

| Verpakking Details: | Buitenste doos |

| Levertijd: | Op basis van inventarisatie |

| Betalingscondities: | T/T |

| Levering vermogen: | Levering door project/batch |

|

Gedetailleerde informatie |

|||

| Model-NR.: | MCX75310AAS-HITT (900-9X7666-003N-ST0) | Poorten: | Poort |

|---|---|---|---|

| Technologie: | Infiniband | Interfacetype: | OSFP56 |

| Specificatie: | 16,7 cm x 6,9 cm | Oorsprong: | India / Israël / China |

| transmissiesnelheid: | 200 gbe | Hostinterface: | Gen3 x16 |

Productomschrijving

Ultra-low latency RDMA-netwerken voor AI-fabrieken, HPC-clusters en hyperscale cloud. Ondersteunt InfiniBand NDR (400Gb/s) en Ethernet tot 400GbE.versnelling van de hardwarebeveiliging, en GPUDirect® Storage klaar.

De NVIDIA ConnectX-7-familie herdefinieert datacenterinterconnectiviteit met bandbreedte tot 400 Gb/s, op hardware gebaseerd betrouwbaar transport en geavanceerde in-netwerk computing.MCX75310AAS-HEATbehoort tot de ConnectX-7 VPI-adapterserie en ondersteunt zowel InfiniBand (NDR/HDR/EDR) als Ethernet (400GbE tot 10GbE).het levert sub-microseconde latentie en bevrijdt CPU-kernen via versnellingsmotoren voor veiligheidMet de PCIe Gen5-host-interface maximaliseert deze adapter de gegevensbeweging voor GPU-clusters en hoogfrequente handelsomgevingen.

Met behulp van ASAP2 (Accelerated Switch and Packet Processing) en Zero-Touch RoCE vereenvoudigt de adapter de implementatie en biedt inline hardware-encryptie van rand tot kern.Bedrijven kunnen hun infrastructuur toekomstbestendig maken met NDR-snelheden en flexibele multi-hostondersteuning.

Dual-port NDR 400Gb/s InfiniBand of 400GbE, PCIe Gen5 x16 (tot 32 lanes).

SHARPv3 collectieve operaties, rendezvous protocol, geheugen voor uitbarstingen.

Inline IPsec/TLS/MACsec AES-GCM 128/256-bit, beveiligde opstart met hardware root-of-trust, flash encryptie.

IEEE 1588v2 PTP (12ns nauwkeurigheid), SyncE, klasse C G.8273.2, time-triggered pacing.

GPUDirect RDMA, GPUDirect Storage, NVMe-oF offload, overdracht van T10-DIF-handtekening.

VXLAN, GENEVE, NVGRE, programmeerbare flexibele parser, verbinding tracking (L4 firewall).

NVIDIA ASAP2 (Accelerated Switch and Packet Processing) offloadt hele datapaden, waardoor line-rate SDN-prestaties worden geleverd met nul CPU-overhead.Paging op aanvraag (ODP)Met ondersteuning voor SR-IOV, VirtIO-versnelling en Multi-Host-technologie (tot 4 hosts),de adapter maakt bare-metal prestaties mogelijk in gevirtualiseerde omgevingenDe hardware RoCE-engine zorgt voor zero-touch-implementatie voor convergeerde Ethernet-fabrieken, terwijl het in-netwerk geheugen de latentie voor MPI en collectieve communicatibibliotheken (NVIDIA HPC-X, UCX,NCCL).

Om de beveiliging van rand tot kern aan te pakken, verwerken inline cryptografie-motoren IPsec, TLS 1.3, en MACsec zonder execution cores te verbruiken, waardoor het ideaal is voor multi-tenant clouds en financiële diensten.

- AI & Large Language Model clusters:RDMA en GPUDirect versnellen gedistribueerde training over honderden GPU's.

- High-Performance Computing (HPC):MPI-afladen, SHARPv3 voor vermindering in het netwerk, adaptieve routing.

- Cloud- en Edge-datacenters:Overlay netwerk versnelling, VXLAN afladen, SR-IOV.

- Software-defined storage (SDS):NVMe/TCP, NVMe-oF, iSER, NFS via RDMA.

- Real-time analyse en handel:Ultra-lage latentie + PTP klasse C synchronisatie.

| Component / Ecosysteem | Ondersteunde opties |

|---|---|

| Host Interface | PCIe Gen5 (maximaal x32-sporen, typisch x16), PCIe-biforcatie, Multi-Host (4 hosts) |

| Operatiesystemen | Linux (RHEL, Ubuntu, in-box stuurprogramma's), Windows Server, VMware ESXi (SR-IOV), Kubernetes |

| Virtualisatie en containers | SR-IOV, VirtIO-versnelling, NVMe over TCP-aflading voor containers |

| HPC-middleware / bibliotheken | OpenMPI, MVAPICH, MPICH, UCX, NCCL, UCC, OpenSHMEM, PGAS |

| Bewaarprotocollen | NVMe-oF (RDMA/TCP), SRP, iSER, NFS over RDMA, SMB Direct, GPUDirect Storage |

| Parameter | Specificatie |

|---|---|

| Productmodel | MCX75310AAS-HEAT |

| Vormfactoren | PCIe HHHL / FHHL, OCP 3.0 SFF/TSFF (zie bestelgids) |

| InfiniBand snelheden | NDR 400 Gbps, HDR 200 Gbps, EDR 100 Gbps |

| Ethernet-snelheden | 400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE (NRZ/PAM4) |

| Netwerkpoorten | 1/2/4-poortconfiguraties (afhankelijk van SKU; typisch voor dit model met 2 poorten) |

| Hostbus | PCI Express Gen 5.0 (compatibel met Gen4/Gen3), maximaal x32-sporen, TLP-verwerkingshints, ATS, PASID |

| Beveiligingsontladingen | Inline IPsec (AES-GCM 128/256), TLS 1.3, MACsec, beveiligde opstart, flash encryptie, apparaatbevestiging |

| RDMA / Vervoer | Hardware betrouwbaar transport, XRC, DCT, On-Demand Paging, UMR, GPUDirect RDMA |

| Timing & Sync | IEEE 1588v2 PTP, G.8273.2 Klasse C, nauwkeurigheid 12 ns, SyncE, PPS in/out, tijdsgeactiveerde planning |

| Beheer | NC-SI, MCTP via PCIe/SMBus, PLDM (DSP0248/0267/0218), SPDM, SPI flash, JTAG |

| Afstandsstarten | InfiniBand remote boot, iSCSI, UEFI, PXE |

| Open netwerken | ASAP2 voor SDN, VXLAN/GENEVE/NVGRE offload, flow mirroring, hiërarchische QoS, L4-verbindingsopsporing |

| Energie en milieu | Verwijzingen naar de gebruikershandleiding (typisch ~15W-25W, afhankelijk van de configuratie), werktemperatuur: 0°C tot 55°C (niet openbaar gespecificeerd, bevestig per SKU) |

| Deelnummer Voorbeeld | Ports / snelheid | Vormfactor | Typisch gebruik |

|---|---|---|---|

| MCX75310AAS-HEAT | NDR 400Gb/s dubbelpoort, PCIe 5.0 x16 | PCIe HHHL / FHHL | Top-of-rack AI & HPC, GPU-clusters |

| MCX75340AAS-HEAT (voorbeeld) | 4 poorten NDR200 / 200GbE | OCP 3.0 | Hyperscale & multi-host |

| Andere ConnectX-7 SKU's | Eenvoudige/dubbele poort, 100G/200G/400G | OCP, FHHL | Ondernemingen, opslagapparatuur |

Voor hulp bij het kiezen van de juiste SKU (kabelondersteuning, type beugel, hoge/korte beugel) neem contact op met het Starsurge-team.

- ✅Originele en gecertificeerde onderdelen- volledige garantie, veilige toeleveringsketen.

- ✅Adviesverlening op het gebied van pre-sales architectuurHPC / AI clusterontwerp, RDMA-tuning.

- ✅Wereldwijde logistiek en snelle levering- de voorraden in Azië/Europa/Amerika.

- ✅Aangepaste firmware & OEM-opties- Verzoek om bulkconfiguratie.

- ✅Technische ondersteuning na verkoop¢ integratie van stuurprogramma's, firmware-updates, RMA.

Hong Kong Starsurge Group biedt volledige levenscyclusondersteuning: van compatibiliteitsvalidatie tot implementatie en voortdurend onderhoud.

- InfiniBand fabric design en prestatie optimalisatie.

- RoCE-configuratie voor Ethernet-omgevingen.

- Integratie met GPUDirect Storage en NVMe-oF-doelen.

- 3 jaar standaard garantie plus uitgebreide dekking.

Volume prijzen, bulk verzending, en aanpassing (beugels, pull-tabs) zijn beschikbaar op aanvraag.

NDR omvat geavanceerde in-netwerk computing functies zoals SHARP, adaptieve routing en hardware betrouwbaar transport native; Ethernet-modus gebruikt RoCE voor RDMA met dezelfde lijnsnelheid.ConnectX-7 ondersteunt beide via dubbele persoonlijkheid.

Ja, de adapter is achterwaarts compatibel met PCIe Gen4 en Gen3, maar bij verminderde rijstroom snelheid.

Ja, ConnectX-7 ondersteunt NVIDIA Multi-Host-technologie, waardoor maximaal 4 onafhankelijke hosts dezelfde adapter kunnen delen (afhankelijk van specifieke SKU en bekabeling).

IPsec (AES-GCM 128/256-bit), TLS (AES-GCM 128/256-bit) en MACsec (AES-GCM 128/256-bit).

Absoluut. ConnectX-7 offloadt NVMe via TCP en NVMe-oF, waardoor de overhead van de host CPU voor opslag wordt verminderd.

- Er moet een goede luchtstroom in het chassis van de server worden gewaarborgd bij het gebruik van krachtige transceivers (actief optisch of DAC).

- Gebruik firmware van NVIDIA of gevalideerd door Starsurge voor beveiligingsoplossingen.

- Installeer de nieuwste stuurprogramma (MLNX_OFED of native inbox) om volledige hardware-afladen mogelijk te maken.

- Verifieer de QSFP-DD- of OSFP-compatibiliteit voor 400G-optica; zie NVIDIA Ethernet Transceiver Guide.

- Antistatische behandeling vereist de adapter bevat gevoelige PCIe-componenten.

Hong Kong Starsurge Group Co., Limitedis een technologiegerichte leverancier van netwerkhardware, IT-diensten en systeemintegratieoplossingen.NICsMet de steun van een ervaren verkoop- en technisch team, ondersteunt Starsurge industrieën zoals overheid, gezondheidszorg, productie,onderwijsHet bedrijf biedt ook IoT-oplossingen, netwerkbeheersystemen, aangepaste softwareontwikkeling, meertalige ondersteuning en wereldwijde levering.Starsurge richt zich op betrouwbare kwaliteit., responsive service en op maat gemaakte oplossingen die klanten helpen efficiënte, schaalbare en betrouwbare netwerkinfrastructuur te bouwen.

✓ Geautoriseerde partner voor toonaangevende merken, waaronder NVIDIA-netwerkproducten.

| Maximale doorvoer | 400 Gb/s (NDR / 400GbE) | PCIe Gen5 | Tot 32 rijstroken |

|---|---|---|---|

| RDMA-ondersteuning | InfiniBand & RoCE | Veiligheid | IPsec/TLS/MACsec inline |

| GPUDirect | RDMA + opslag | Tijdnauwkeurigheid | 12ns PTP |

| Component | Aanbevolen / ondersteund | Opmerkingen |

|---|---|---|

| GPU-servers (HGX / DGX) | Volledig compatibel met GPUDirect | SHARP-afladen op InfiniBand |

| Opstaande schakelaars | NVIDIA QM9700 (NDR), SN4000 (Ethernet) | Ondersteund |

| Virtualisatie hosts | VMware ESXi 7.0/8.0, KVM, Hyper-V | SR-IOV ingeschakeld |

| opslagsystemen | PureStorage, VAST Data, WEKA, Dell PowerScale | NVMe-oF / RoCE klaar |

| Kabels / optica | NVIDIA passief koperen DAC, actief optisch (400G SR4/DR4) | Bevestig compatibiliteitsmatrix |

- Bevestig dat de poortconfiguratie (2-poort NDR of split 2x200G) overeenkomt met uw schakelplan.

- Bevestig de fysieke lengte van de PCIe-slot en het type beugel (HHHL / FHHL).

- Controleer de richting van de luchtstroom en de vereisten voor passieve/actieve kabels.

- Zorg voor ondersteuning van OS-stuurprogramma's (MLNX_OFED-versie voor de kernel).

- Voor beveiligingsfuncties: activeer veilige opstart en inline cryptografie in firmware.

- Controleer de garantie en de vervangingsmogelijkheden.

64-poort 400G InfiniBand, SHARPv3 integratie.

Kosten-efficiënte 200 Gbps voor kleinere clusters.

opslag en beveiliging versnelling + programmeerbaar gegevenspad.

Conforme OSFP tot 2xOSFP of 2xQSFP56.