NVIDIA ConnectX-6 InfiniBand Adapter MCX653105A-HDAT – 200Gb/s RDMA Hardwareversleuteling

Productdetails:

| Merknaam: | Mellanox |

| Modelnummer: | MCX653106A-HDAT-SP |

| Document: | connectx-6-infiniband.pdf |

Betalen & Verzenden Algemene voorwaarden:

| Min. bestelaantal: | 1 stks |

|---|---|

| Prijs: | Negotiate |

| Verpakking Details: | Buitenste doos |

| Levertijd: | Op basis van inventarisatie |

| Betalingscondities: | T/T |

| Levering vermogen: | Levering door project/batch |

|

Gedetailleerde informatie |

|||

| Productenstatus: | Voorraad | Sollicitatie: | Server |

|---|---|---|---|

| Voorwaarde: | Nieuw en origineel | Type: | Bedraad |

| Maximale snelheid: | Tot 200 GB/s | Ethernet -connector: | QSFP56 |

| Model: | MCX653106A-HDAT | Naam: | Van de het Netwerkkaart 200gbe van mcx653106a-hdat-SP Mellanox de Hoge snelheids Slimme Brandkast |

Productomschrijving

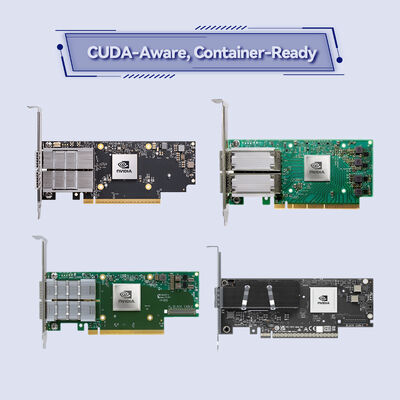

MCX653105A-HDAT ¢ Single-Port 200Gb/s

De NVIDIA® ConnectX®-6 MCX653105A-HDAT-smart adapterkaart is ontworpen voor veeleisende HPC-, AI- en hyperscale cloud-infrastructuur.Bandbreedte 200 GB/sHet ontladen van kritieke gegevensverkeer en beveiliging taken van de CPU, het drastisch verbetert de efficiëntie, schaalbaarheiden beveiliging van deep neural network training tot realtime data-analyse en NVMe-oF-opslag.

Als kerncomponent van het NVIDIA Quantum InfiniBand-platform maakt ConnectX-6 end-to-end RDMA, hardware-gebaseerd betrouwbaar transport en geavanceerde congestiebeheersing mogelijk.MCX653105A-HDAThet single-port-model biedt een kosteneffectieve maar krachtige toegang tot HDR InfiniBand- en 200GbE-netwerken met 200 Gb/s. Het integreert block-level XTS-AES-codering, NVMe over Fabrics (NVMe-oF) offloads,en GPUDirect RDMA-versnelling, waardoor het de ideale keuze is voor GPU-versnelde clusters, software-defined storage en high-frequency trading omgevingen waar lage latentie en beveiliging van het grootste belang zijn.

NVIDIA ConnectX-6 breidt Remote Direct Memory Access (RDMA) uit tot buiten de conventionele grenzen.en dynamisch verbonden vervoer (DCT)De adapter is een van de meest efficiënte oplossingen voor het vergroten van de schaalbaarheid van een netwerk.NetwerkgeheugenIn combinatie met PCIe Gen 4 is het mogelijk om zonder registratie toegang te krijgen tot RDMA-geheugen, waardoor de software overhead wordt verminderd.0, data gaat rechtstreeks tussen geheugen en netwerk, waardoor CPU-cycli vrijkomen voor applicatielogica.op hardware gebaseerd betrouwbaar transport en end-to-end stroomcontrole op pakketniveau waarborgen datintegratie van gegevens zelfs onder extreme belasting.

Met steun vanRoCE (RDMA over Converged Ethernet)ConnectX-6 biedt een unified smart fabric voor zowel InfiniBand als Ethernet-omgevingen.

- High Performance Computing (HPC):Grootschalige simulaties, weermodellering, computationele chemie die deterministische lage latentie vereisen.

- AI & Machine Learning:Versnellen van gedistribueerde training van diepe neurale netwerken met GPUDirect RDMA en 200Gb/s doorvoer.

- NVMe-oF-opslagarrays:Gebouwd hoogwaardige NVMe/TCP of NVMe/RDMA opslagdoelen met hardware offloads, waardoor de CPU-belasting met maximaal 30% wordt verminderd.

- Hyperscale Cloud & NFV:Efficiënte service-chaining, OVS-offload (ASAP2) en SR-IOV voor tot 1K virtuele functies.

- Financiële diensten en handel:Distributie van marktgegevens en algoritmische handelsinfrastructuur met een ultralage latentie.

ConnectX-6 MCX653105A-HDAT is compatibel met een breed scala aan servers, switches en besturingsomgevingen.InfiniBand-switches tot 200 Gb/s (HDR)enEthernet-switches tot 200 Gb/sDe adapter werkt op x86, Power, Arm, GPU en FPGA-platforms.

| Categorie | Ondersteunde opties / normen |

|---|---|

| Operatiesystemen | RHEL, SLES, Ubuntu, andere grote Linux distributies, Windows Server, FreeBSD, VMware vSphere |

| InfiniBand-specificatie | IBTA 1.3-compatibel, 200/100/50/25/10Gb/s, 8 virtuele rijstroken + VL15, op hardware gebaseerde congestiebeheersing |

| Ethernet-standaarden | 200/100/50/40/25/10/1GbE, IEEE 802.3bj, 802.3by, 802.3ba, PFC, ETS, DCB, 1588v2, Jumbo frame (9.6KB) |

| CPU-afladen en virtualisatie | SR-IOV (tot 1K VF), NPAR, DPDK, ASAP2 OVS-afladen, tunnelverkapseling/dekapseling (VXLAN, NVGRE, Geneve) |

| Beheer en opstart | NC-SI, MCTP via SMBus/PCIe, PLDM (DSP0248/DSP0267), UEFI, PXE, iSCSI remote boot, InfiniBand remote boot |

| Parameter | Detail |

|---|---|

| Productmodel | MCX653105A-HDAT |

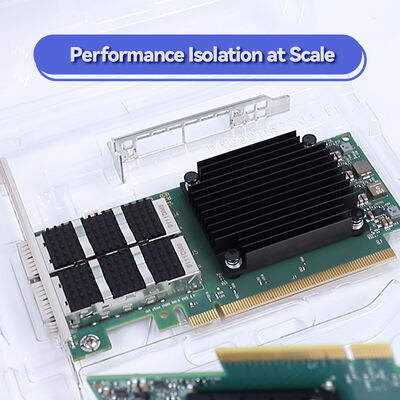

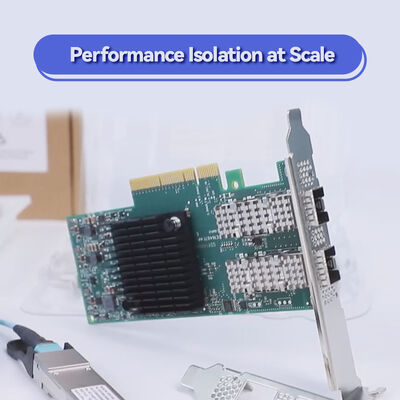

| Vormfactor | PCIe Stand-up, laag profielbeugel inbegrepen, hoog beugel gemonteerd, kort beugel als accessoire |

| Netwerkpoorten | 1x QSFP56 (eenpoort) |

| Ondersteunde snelheden (infiniband) | 200/100/50/25/10 Gb/s |

| Ondersteunde snelheden (Ethernet) | 200/100/50/40/25/10/1 Gb/s |

| Host Interface | PCIe Gen 3.0/4.0 x16 (steunt ook x8, x4, x2, x1) |

| Maximale bandbreedte | 200 Gb/s |

| Meldingspercentage | Tot 215 miljoen berichten per seconde |

| Latentie | Extreme lage (submicroseconde RDMA) |

| Hardwarekodificatie | XTS-AES 256/512-bits block-level encryptie, FIPS-compatibel |

| opslag en losladen | NVMe-oF doelgroep/initiatiefnemer, T10-DIF, SRP, iSER, NFS RDMA, SMB Direct |

| Virtualisatie | SR-IOV (tot 1K VF's), VMware NetQueue, QoS per VM |

| Afstandsstarten | InfiniBand, Ethernet, iSCSI, UEFI, PXE |

| Afmetingen (zonder beugel) | 167.65 mm x 68.90 mm |

| RoHS en naleving | RoHS-compatibel, ODCC-compatibel |

| Nummer van het besteldeel (OPN) | Ports / snelheid | Host Interface | Belangrijkste kenmerken |

|---|---|---|---|

| MCX653105A-HDAT | 1x QSFP56, tot 200 Gb/s | PCIe 3.0/4.0 x16 | Single-port, cryptosupport, standaardbeugel |

| MCX653106A-HDAT | 2x QSFP56, tot 200 Gb/s | PCIe 3.0/4.0 x16 | Dual-port, cryptosupport |

| MCX653105A-ECAT | 1x QSFP56, tot 100 Gb/s | PCIe 3.0/4.0 x16 | 100 Gb/s variant, geen cryptografie |

| MCX653435A-HDAT (OCP 3.0) | 1x QSFP56, 200 Gb/s | PCIe x16 | OCP 3.0 kleine vormfactor |

| MCX654105A-HCAT | 1x QSFP56, Socket Direct | 2x PCIe 3.0 x16 | Socket Direct met toegewijde CPU toegang |

Opmerking: voor koelplatenvarianten voor vloeistofgekoelde Intel Server System D50TNP, neem contact op met Starsurge voor een aangepaste bestelling.

100% authentieke NVIDIA ConnectX-6 adapters met volledige batch traceerbaarheid.

Warehouse hubs in Azië, Europa en Amerika die meer dan 50 landen bedienen.

Firmware-configuratie, RDMA-tuning, NVMe-oF-validatie, chauffeursassistentie.

Lange termijn partnerschap met NVIDIA distributeurs, volume kortingen beschikbaar.

Makkelijke vervanging en geavanceerde cross-ship voor kritieke inzet.

Ondersteuning in het Engels, Chinees en Japans; integratie en etikettering op maat.

Hong Kong Starsurge Group biedt end-to-end ondersteuning: van compatibiliteitscontroles, firmware-aanpassingen tot leiding bij de inzet ter plaatse.We bieden toegewijde technische accountmanagers voor datacenter upgrades en proof-of-concept (PoC) testen.Alle adapters worden geleverd met antistatische verpakking en optionele installatie kits.

Ondersteuningsprogramma's omvatten:24/5 technische ondersteuning ticketing systeem, geavanceerde vervanging voor bedrijfskritische omgevingen, driver & software stack assistentie (OFED, WinOF-2, DPDK), en remote troubleshooting.

- Bevestig de mechanische afstand van de server: standaardhoogte PCIe-beugel inbegrepen; laagprofielbeugel ook als accessoire.

- Voor vloeistofgekoelde platforms (Intel D50TNP) moet u vóór het bestellen de beschikbaarheid van de koelplaat optie controleren.

- Bevestig de compatibiliteit van de stuurprogramma's met uw Linux-distributieversie ?? NVIDIA MLNX_OFED aanbevolen voor optimale prestaties.

- Niet openbaar gespecificeerd: nauwkeurig stroomverbruik bij volledige 200Gb/s-belasting, zie de NVIDIA gebruikershandleiding of contact opnemen met Starsurge voor typische waarden (ongeveer 13-16W).

- FIPS-certificering is hardware-compatibel, maar kan een specifieke firmwareversie vereisen.

- Een enkele poort adapter kan niet worden gebruikt voor poort redundantie; voor high-availability ontwerpen, overwegen dual-poort MCX653106A-HDAT.

Opgericht in 2008,Hong Kong Starsurge Group Co., LimitedMet een wereldwijd klantenbestand van overheid, gezondheidszorg, productie, onderwijs, financiën,en bedrijfssectorStarsurge levert netwerkapparatuur met hoge prestaties, waaronder switches, NIC's, draadloze oplossingen en op maat gemaakte software.Het bedrijf combineert ervaren verkoop- en technische teams om complexe infrastructuurprojecten te ondersteunenKlantgerichte aanpak, betrouwbare kwaliteit en snelle wereldwijde levering maken Starsurge tot een vertrouwde partner voor datacenters van de volgende generatie.

Contact opnemen met Starsurge Team| Feit | Waarde |

|---|---|

| Maximale doorvoer | 200 Gb/s (een enkele poort) |

| On-chip versnellingsmotoren | Tag matching, rendezvous offload, collectieve offloads, burst buffer offload |

| Maximale virtuele functies | Maximaal 1024 VF per adapter |

| Versleutelingstandaard | XTS-AES 256/512-bit, hardware losgeladen van de CPU |

| Adaptieve routing ondersteuning | Out-of-order RDMA met adaptieve routing |

| Netwerkgeheugen | Registratievrije RDMA-geheugentoegang |

| Server / platform | CPU architectuur | Beproefd besturingssysteem / omgeving |

|---|---|---|

| Dell PowerEdge R750/R760 | Intel Xeon Scalable Gen 3/4 | RHEL 8.6+, Ubuntu 22.04, VMware ESXi 7.0/8.0 |

| HPE ProLiant DL380 Gen10/Gen11 | Intel Xeon | SLES 15 SP4, Windows Server 2022 |

| Supermicro Ultra SuperServer | AMD EPYC 7002/7003 | Ubuntu 20.04/22.04, Rocky Linux 8 |

| Lenovo ThinkSystem SR650/SR655 | Intel / AMD EPYC | RHEL 9, Windows Server 2019 |

| NVIDIA DGX A100 / H100 | x86_64 / NVIDIA Arm | Ubuntu met MLNX_OFED, NVIDIA HPC SDK |

- ¢ Beschikbaarheid van PCIe-slots: x16 mechanisch (elektrisch x16/x8/x4 ondersteund)

- Vereiste poortsnelheid: 200 Gb/s of minder; kabeltype (QSFP56 passieve DAC of actieve optica)

- OS-driverversie: Controleer MLNX_OFED of WinOF-2-compatibiliteit met je kernel

- ¢ Versleuteling vereiste: standaard AES-XTS- of FIPS-modus (speciale firmware)

- - Koeling en beugel: standaard luchtgekoelde of koude plaat optie voor vloeistofkoeling

- Hoeveelheid en levertijd: voorraadbevestiging bij Starsurge verkoopteam

- ¢ Voorgenomen toepassing: Een enkele poort volstaat of moet er een dubbele poort overbodig zijn?

QM8700 / QM9700 serie, 40 poorten HDR 200Gb/s, volledig beheerd

Geoptimaliseerd voor Ethernet en RoCE, 200Gb/s met laag vermogen

InfiniBand/Ethernet met programmeerbaar gegevenspad en isolatie

DAC, AOC en actieve glasvezelkabels voor 200G QSFP56

- ▸ NVIDIA ConnectX-6 gebruikershandleiding (Firmware & Configuration Guide)

- ▸ RDMA over Converged Ethernet (RoCE) Implementatie beste praktijken

- ▸ NVMe-oF met ConnectX-6: Performance Tuning Guide

- ▸ GPUDirect RDMA voor AI-clusters

- ▸ Bloc-level encryptie instellen voor FIPS-omgevingen