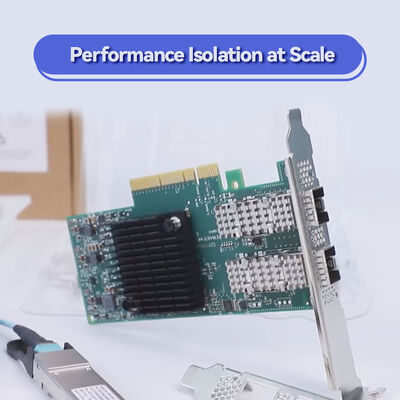

NVIDIA ConnectX-6 MCX653105A-HDAT 200Gb/s Single-Port InfiniBand Smart Adapter met Hardware Encryption en PCIe 4.0

Productdetails:

| Merknaam: | Mellanox |

| Modelnummer: | MCX653105A-HDAT |

| Document: | connectx-6-infiniband.pdf |

Betalen & Verzenden Algemene voorwaarden:

| Min. bestelaantal: | 1 stks |

|---|---|

| Prijs: | Negotiate |

| Verpakking Details: | Buitenste doos |

| Levertijd: | Op basis van inventarisatie |

| Betalingscondities: | T/T |

| Levering vermogen: | Levering door project/batch |

|

Gedetailleerde informatie |

|||

| Productenstatus: | Voorraad | Sollicitatie: | Server |

|---|---|---|---|

| Voorwaarde: | Nieuw en origineel | Type: | Bedraad |

| Maximale snelheid: | Tot 200 GB/s | Ethernet -connector: | QSFP56 |

| Model: | MCX653105A-HDAT | ||

| Markeren: | NVIDIA ConnectX-6 Infiniband adapter,200 Gb/s PCIe 4.0-netwerkkaart,InfiniBand-adapter met hardware-encryptie |

||

Productomschrijving

Single-poorts HDR Smart Adapter van 200 Gb/s met In-Network Computing & Hardwarematige Versleuteling

De NVIDIA ConnectX-6 1x QSFP56 levert een volledige doorvoer van 200 Gb/s op één QSFP56-poort, met een ultralage latentie, hardwarematige offloads en block-level XTS-AES-versleuteling. Deze PCIe 4.0 x16-adapter is ontworpen voor HPC-, AI-clusters en NVMe-oF-opslag en offloadt collectieve bewerkingen, RDMA en versleuteling van de CPU, waardoor de prestaties van applicaties en de schaalbaarheid in veeleisende datacenteromgevingen worden gemaximaliseerd.

De 1x QSFP56 behoort tot de NVIDIA ConnectX-6 InfiniBand-adapterfamilie, ontworpen voor extreme prestaties in moderne datacenters. Deze kaart met één QSFP56-poort ondersteunt tot PCIe 3.0/4.0 x16 (HDR InfiniBand of 200 GbE) met volledige hardwareversnelling voor RDMA, betrouwbaar transport en In-Network Computing. Door de integratie van offloads voor collectieve bewerkingen, MPI-tagmatching en versnelling van NVMe over Fabrics, vermindert de adapter de CPU-overhead aanzienlijk en verhoogt de efficiëntie van het netwerk. De ingebouwde AES-XTS block-level versleuteling zorgt voor gegevensbeveiliging zonder prestatieverlies, waardoor deze ideaal is voor financiële dienstverlening, overheidsresearch en hyperscale cloud-implementaties.

Tot 200 Gb/s (HDR InfiniBand / 200 GbE) op enkele QSFP56

Tot 215 miljoen berichten/sec

Block-level XTS-AES 256/512-bit, FIPS-conform

Collectieve offloads, NVMe-oF target/initiator offloads, burst buffer

PCIe Gen 4.0 / 3.0 x16 (achterwaarts compatibel)

SR-IOV (1K VFs), ASAP2, Open vSwitch offload, overlay tunnels

RoCE, XRC, DCT, On-Demand Paging, GPUDirect RDMA-ondersteuning

Staande PCIe low-profile, hoge bracket voorgeïnstalleerd + korte bracket meegeleverd

NVIDIA ConnectX-6 integreert In-Network Computing versnellingsengines die kritieke datacenterbewerkingen offloaden van de host-CPU. De MCX653105A-HDAT ondersteunt hardwarematige betrouwbare transport-, adaptieve routerings- en congestiebeheerfuncties, wat zorgt voor voorspelbare prestaties in grootschalige netwerken. Remote Direct Memory Access (RDMA) maakt zero-copy gegevensoverdrachten mogelijk, waarbij de OS-kernel wordt omzeild. Met NVIDIA GPUDirect RDMA communiceert GPU-geheugen rechtstreeks met de netwerkadapter, wat de latentie voor AI-training en HPC-simulaties drastisch vermindert. Ingebouwde block-level XTS-AES-versleuteling (256/512-bit sleutel) zorgt voor beveiliging van data-in-transit en data-at-rest zonder CPU-overhead, en de adapter is ontworpen om te voldoen aan de FIPS 140-2 compliancevereisten.

- High Performance Computing (HPC): Grootschalige simulaties, weersvoorspelling en computationele vloeistofdynamica die een 200 Gb/s low-latency interconnect vereisen.

- AI & Deep Learning Clusters: Gedistribueerde training met GPUDirect RDMA, maximaliseert de doorvoer tussen GPU-nodes.

- NVMe-oF Opslagsystemen: High-performance gedisaggregeerde opslag met volledige target/initiator offloads, waardoor CPU-gebruik wordt verminderd.

- Hyperscale & Cloud Datacenters: Gevirtualiseerde omgevingen met SR-IOV, overlay-netwerken en hardware-versnelde versleuteling.

- Financiële Handelsplatforms: Ultra-low latency deterministisch netwerken voor algoritmische handel.

De ConnectX-6 MCX653105A-HDAT werkt naadloos samen met NVIDIA Quantum InfiniBand-switches (HDR 200 Gb/s), standaard 200 GbE-switches en een breed scala aan serverplatforms. Het ondersteunt de belangrijkste besturingssystemen en virtualisatiestacks, wat zorgt voor flexibele integratie in bestaande infrastructuur.

| Parameter | Specificatie |

|---|---|

| Productmodel | 1x QSFP56 |

| Gegevensoverdrachtsnelheid | 200 Gb/s, 100 Gb/s, 50 Gb/s, 40 Gb/s, 25 Gb/s, 10 Gb/s, 1 Gb/s (InfiniBand en Ethernet) |

| Poorten & Connector | 1x QSFP56 (ondersteunt passieve koper, actieve optische en AOC-kabels) |

| Belangrijkste Kenmerken | PCIe Gen 4.0 x16 (ook compatibel met Gen 3.0, 2.0; ondersteunt x8, x4, x2, x1 configuraties) |

| Latentie | Sub-microseconde (typisch <0.7µs)Berichtensnelheid |

| Tot 215 miljoen berichten per seconde | Versleuteling |

| XTS-AES 256/512-bit hardware offload, FIPS 140-2 gereed | Vormfactor |

| PCIe low-profile staand (hoge bracket voorgeïnstalleerd, korte bracket accessoire meegeleverd) | Afmetingen (zonder bracket) |

| 167,65 mm x 68,90 mm | Stroomverbruik |

| Typisch 22W – 24W (afhankelijk van linkgebruik) | Virtualisatie |

| SR-IOV (tot 1K Virtual Functions), VMware NetQueue, NPAR, ASAP2 flow offload | Beheer & Monitoring |

| NC-SI, MCTP over PCIe/SMBus, PLDM (DSP0248, DSP0267), I2C, SPI flash | Remote Boot |

| InfiniBand, iSCSI, PXE, UEFI | Besturingssystemen |

| RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, OpenFabrics Enterprise Distribution (OFED), WinOF-2 | Selectiegids – ConnectX-6 Adaptervarianten |

| Poorten | Max. Snelheid | Host Interface | Belangrijkste Kenmerken | MCX653105A-HDAT |

|---|---|---|---|---|

| 1x QSFP56 | 100 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 kleine vormfactor, dual-poort 200 Gb/s | MCX653106A-HDAT |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 kleine vormfactor, dual-poort 200 Gb/s | MCX653105A-ECAT |

| 1x QSFP56 | 100 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 kleine vormfactor, dual-poort 200 Gb/s | MCX653106A-ECAT |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 kleine vormfactor, dual-poort 200 Gb/s | MCX653436A-HDAT (OCP 3.0) |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 kleine vormfactor, dual-poort 200 Gb/s | Opmerking: MCX653105A-HDAT bevat een volledige hardwarematige versleutelingsengine (XTS-AES) en ondersteunt zowel InfiniBand- als Ethernet-protocollen tot 200 Gb/s. Voor dual-poort configuraties, overweeg -HDAT varianten met twee QSFP56 cages. |

- Single-poort ontwerp levert maximale doorvoer voor rekenknooppunten waar hoge dichtheid per poort prioriteit heeft.Ingebouwde Hardwarebeveiliging:

- XTS-AES blockversleuteling zonder CPU-overhead, voldoet aan FIPS-compliance voor gereguleerde sectoren.Versnelde Opslag & AI:

- NVMe-oF offloads en GPUDirect RDMA verhogen de prestaties aanzienlijk voor AI-training en software-defined storage.Toekomstbestendige PCIe 4.0:

- Verdubbelt de interconnect-bandbreedte naar de host, waardoor knelpunten voor 200 Gb/s-netwerken worden geëlimineerd.Vereenvoudigd Beheer:

- Uniforme driverstack (OFED, WinOF-2) en brede OS-compatibiliteit verminderen de implementatiecomplexiteit.Service & Ondersteuning

Veelgestelde Vragen

• Voor vloeistofgekoelde platforms is deze standaard luchtgekoelde kaart niet compatibel met cold plate varianten; neem contact op met Starsurge voor vloeistofgekoelde SKU's.

• Gebruik altijd QSFP56-geclassificeerde kabels of modules om 200 Gb/s prestaties te bereiken.

• Controleer de compatibiliteit van de driverversie met uw OS en kernel vóór implementatie.

Over Hong Kong Starsurge Group

Wereldwijde levering · Meertalige ondersteuning · Op maat gemaakte OEM & integratiediensten

Belangrijkste Feiten in één Oogopslag

| Ondersteuningsstatus | Opmerkingen | NVIDIA Quantum HDR InfiniBand Switches |

|---|---|---|

| ConnectX-6 Dual-Poort 200 Gb/s Adapter (MCX653106A-HDAT) | 200 Gb/s netwerk, adaptieve routering | 200 GbE Switches (IEEE 802.3) |

| ✓ Compatibel | Vereist FEC-modi per switchspecificatie | GPU Direct RDMA |

| ✓ Ja | NVIDIA GPU-series (Volta, Ampere, Hopper, etc.) | VMware vSphere 7.0/8.0 |

| ✓ Gecertificeerd | Native drivers, SR-IOV-ondersteuning | Linux (RHEL, Ubuntu, SLES) |

| ✓ Volledige ondersteuning | MLNX_OFED, inbox drivers beschikbaar | Windows Server 2019/2022 |

| ✓ Ondersteund | WinOF-2 driverpakket | Koperschecklist – Vóór Bestelling MCX653105A-HDAT |

- [ ] Controleer server PCIe-slot: fysiek x16 slot, Gen 4 aanbevolen voor volledige 200 Gb/s prestaties.

- [ ] Selecteer geschikte QSFP56-kabels of transceivers (passief koper tot 5m, AOC of optiek).

- [ ] Verifieer OS-driverondersteuning (OFED-versie of inbox).

- [ ] Zorg ervoor dat aan de compliancevereisten voor versleuteling wordt voldaan (XTS-AES, FIPS).

- [ ] Evalueer omgevingskoeling: snelle adapters kunnen gerichte luchtstroom vereisen.

- Gerelateerde Producten