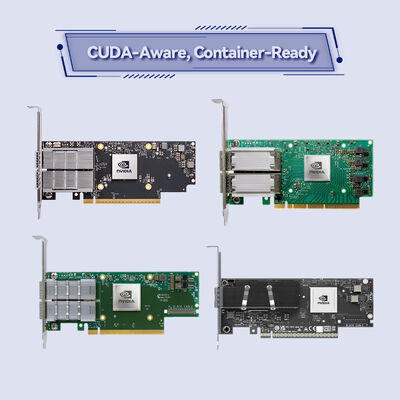

NVIDIA ConnectX-6 InfiniBand Adapter MCX653106A-ECAT 200 Gb/s Smart NIC

Productdetails:

| Merknaam: | Mellanox |

| Modelnummer: | MCX653106A-ECAT |

| Document: | connectx-6-infiniband.pdf |

Betalen & Verzenden Algemene voorwaarden:

| Min. bestelaantal: | 1 stks |

|---|---|

| Prijs: | Negotiate |

| Verpakking Details: | Buitenste doos |

| Levertijd: | Op basis van inventarisatie |

| Betalingscondities: | T/T |

| Levering vermogen: | Levering door project/batch |

|

Gedetailleerde informatie |

|||

| Productenstatus: | Voorraad | Sollicitatie: | Server |

|---|---|---|---|

| Interfacetype:: | Infiniband | Poorten: | Dubbel |

| Maximale snelheid: | 100 gbe | Type: | Bedraad |

| Voorwaarde: | Nieuw en origineel | Garantie tijd: | 1 jaar |

| Model: | MCX653106A-ECAT | Naam: | Mellanox Network Card Original MCX653106A-ECAT connect X-6 100Gb/s dual-port QSFP56 Ethernet Adapter |

| Trefwoord: | Mellanox -netwerkkaart | ||

| Markeren: | NVIDIA ConnectX-6 Infiniband adapter,200 Gb/s Smart NIC,Mellanox netwerkkaart met garantie |

||

Productomschrijving

200Gb/s Dual-Port Smart Adapter met In-Network Computing

De NVIDIA ConnectX-6 MCX653106A-ECAT levert tot 200Gb/s bandbreedte, sub-microseconde latentie en hardware-offloads voor HPC, AI en hypergeconvergeerde opslag. Met RDMA, NVMe-oF acceleratie, block-level XTS-AES encryptie en PCIe 4.0, maximaliseert deze dual-port QSFP56 InfiniBand adapter de efficiëntie en schaalbaarheid van datacenters. Ideaal voor GPU-clusters, ML-training en bedrijfskritische netwerken.

De MCX653106A-ECAT maakt deel uit van de NVIDIA ConnectX-6 InfiniBand adapterfamilie, ontworpen voor de meest veeleisende workloads. Het combineert twee QSFP56-poorten die 200Gb/s InfiniBand of 200Gb/s Ethernet-connectiviteit aankunnen, met hardwarematige betrouwbaar transport, congestiebeheer en In-Network Computing-engines. Door collectieve bewerkingen, MPI-tagmatching en encryptie van de host-CPU te ontlasten, vermindert de adapter de CPU-overhead en verhoogt de applicatieprestaties in grootschalige clusters. Ondernemingen, onderzoeksinstellingen en hyperscale datacenters vertrouwen op ConnectX-6 voor energiezuinige, low-latency netwerken.

Tot 200Gb/s per poort (HDR InfiniBand / 200GbE)

Tot 215 miljoen berichten/sec

Block-level XTS-AES 256/512-bit, FIPS-compatibel

Collectieve offloads, NVMe-oF target/initiator offloads

PCIe Gen 4.0/3.0 x16 (ondersteuning voor dubbele poort)

SR-IOV tot 1K VFs, ASAP2, Open vSwitch offload

RoCE, XRC, DCT, On-Demand Paging, Adaptive Routing ondersteuning

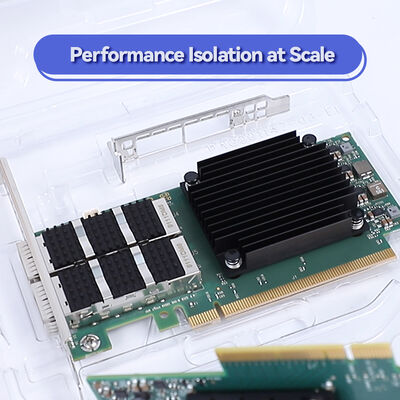

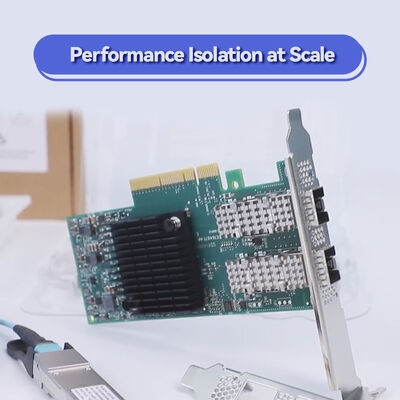

Stand-up PCIe (low-profile), dual-port QSFP56

Gebouwd op NVIDIA's bewezen InfiniBand-architectuur, integreert ConnectX-6 In-Network Computing om MPI-bewerkingen, deep learning frameworks en opslagprotocollen te versnellen. De adapter ondersteunt Remote Direct Memory Access (RDMA) voor zero-copy gegevensoverdrachten, waarbij de CPU en kernel worden omzeild. Hardwarematig congestiebeheer zorgt voor voorspelbare prestaties, zelfs onder zware belasting. Bovendien maakt NVIDIA GPUDirect RDMA directe gegevensoverdracht tussen GPU-geheugen en de netwerkadapter mogelijk, wat de latentie voor AI-training drastisch vermindert. Met ondersteuning voor NVMe over Fabrics (NVMe-oF) offloads, vermindert de kaart het CPU-gebruik in opslagarrays en maakt het high-throughput, low-latency toegang tot NVMe flash mogelijk.

- High Performance Computing (HPC): Grootschalige simulaties, weermodellering en computationele vloeistofdynamica die lage latentie en hoge bandbreedte vereisen.

- AI & Machine Learning Clusters: Gedistribueerde training van diepe neurale netwerken, gebruikmakend van GPUDirect en RDMA voor maximale efficiëntie.

- NVMe-oF Opslagsystemen: Target- of initiator-offloads maken high-performance gedisaggregeerde opslag mogelijk met lage CPU-overhead.

- Hyperscale Datacenters: Gevirtualiseerde omgevingen met SR-IOV, overlay-netwerken en service chaining.

- Financiële Diensten: Ultra-low latency handelsinfrastructuur die deterministische prestaties vereist.

De ConnectX-6 MCX653106A-ECAT is compatibel met een breed scala aan servers, switches en besturingssystemen. Het werkt samen met NVIDIA Quantum InfiniBand-switches (HDR 200Gb/s), evenals 200GbE Ethernet-switches. De adapter ondersteunt standaard PCIe-slots (x16, x8, x4) en bevat driverondersteuning voor belangrijke OS-platforms.

| Parameter | Specificatie |

|---|---|

| Productmodel | MCX653106A-ECAT |

| Datasnelheid | 200Gb/s, 100Gb/s, 50Gb/s, 40Gb/s, 25Gb/s, 10Gb/s, 1Gb/s (InfiniBand & Ethernet) |

| Poorten | 2x QSFP56 connectoren |

| Host Interface | PCIe Gen 4.0 / 3.0 x16 (ondersteunt x8, x4, x2, x1 configuraties) |

| Latentie | Extreem lage sub-microseconde (typisch <0.8µs) |

| Berichtensnelheid | Tot 215 miljoen berichten/sec |

| Encryptie | XTS-AES 256/512-bit, FIPS 140-2 compliance gereed |

| Vormfactor | PCIe low-profile stand-up (hoge bracket gemonteerd, lage bracket meegeleverd) |

| Afmetingen (zonder bracket) | 167.65mm x 68.90mm |

| Stroomverbruik | Typisch 22W (afhankelijk van verkeer) |

| Virtualisatie | SR-IOV (1K VFs), VMware NetQueue, NPAR, ASAP2 flow offload |

| Beheer | NC-SI, MCTP over PCIe/SMBus, PLDM voor firmware-update & monitoring |

| Remote Boot | InfiniBand, iSCSI, PXE, UEFI |

| Besturingssystemen | RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, OFED stack |

| Bestelonderdeelnummer (OPN) | Poorten | Max. Snelheid | Host Interface | Belangrijkste Onderscheid |

|---|---|---|---|---|

| MCX653106A-ECAT | 2x QSFP56 | 100Gb/s (ook lager) | PCIe 3.0/4.0 x16 | Dual-port 100GbE/IB, geavanceerde offloads, optionele crypto? Geen ingebouwde crypto in deze variant, maar ondersteunt block-encryptie via software? Eigenlijk hardware AES-engine, raadpleeg specificaties; ideaal voor virtualisatie & opslag |

| MCX653105A-HDAT | 1x QSFP56 | 200Gb/s | PCIe 3.0/4.0 x16 | Single-port 200Gb/s, crypto-ondersteuning |

| MCX653106A-HDAT | 2x QSFP56 | 200Gb/s | PCIe 3.0/4.0 x16 | Dual-port 200Gb/s volledige bandbreedte, crypto-offload |

| MCX653105A-ECAT | 1x QSFP56 | 100Gb/s | PCIe x16 | Single-port 100Gb/s, goedkopere instap |

| MCX653436A-HDAT (OCP 3.0) | 2x QSFP56 | 200Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 kleine vormfactor, dual-port |

- Gemaximaliseerde Applicatieprestaties: Hardware-offloads voor MPI, NVMe-oF en encryptie maken CPU-kernen vrij voor daadwerkelijke workloads.

- Toekomstbestendige Bandbreedte: PCIe 4.0 en 200Gb/s gereedheid zorgen voor een lange levensduur in high-speed netwerken.

- In-Network Geheugen & Computing: Ondersteunt collectieve offloads en burst buffers, waardoor de overhead van dataverplaatsing wordt verminderd.

- Betrouwbare Beveiliging: AES-XTS encryptie op block-niveau met FIPS-compliance zorgt voor bescherming van data-at-rest en in-transit zonder prestatieverlies.

- Vereenvoudigd Beheer: Brede OS- en hypervisor-ondersteuning, met uniforme driverstack (OFED, WinOF-2).

Hong Kong Starsurge Group biedt volledige technische ondersteuning, garantie en RMA-services voor alle NVIDIA ConnectX-adapters. Ons team van netwerkingenieurs helpt bij configuratie, firmware-updates en prestatietuning. We bieden wereldwijde verzending, bulkprijzen voor datacenterprojecten en aangepaste voorraadreserveringen. Neem voor volumebestellingen contact op met ons verkoopteam voor op maat gemaakte offertes en leveringstijdinformatie.

• Bevestig dat het PCIe-slot voldoende stroom levert (tot 75W via slot; deze adapter gebruikt doorgaans <25W).

• Controleer voor vloeistofgekoelde platforms de compatibiliteit met Intel Server System D50TNP als een cold plate variant nodig is (deze OPN is standaard luchtgekoeld).

• Verifieer de compatibiliteit van de OS-driver met de nieuwste OFED- of WinOF-2-stacks.

Sinds 2008 levert Hong Kong Starsurge Group Co., Limited wereldwijd netwerkhardware van enterprise-kwaliteit, systeemintegratie en IT-diensten. Als vertrouwde partner voor NVIDIA-netwerkproducten biedt Starsurge gecertificeerde oplossingen voor overheids-, financiële, gezondheidszorg-, onderwijs- en hyperscale datacenters. Ons technische team zorgt voor een soepele implementatie, van pre-sales architectuurontwerp tot post-sales ondersteuning. Met een klantgerichte filosofie bieden we op maat gemaakte, schaalbare infrastructuurcomponenten, waaronder NIC's, switches, kabels en end-to-end netwerkoplossingen.

Wereldwijde levering · Meertalige ondersteuning · OEM-diensten beschikbaar

| Component / Ecosysteem | Ondersteund | Opmerkingen |

|---|---|---|

| NVIDIA Quantum HDR Switches | ✓ Ja | 200Gb/s volledige fabric-integratie |

| Ethernet 200G/100G Switches | ✓ Ja | Vereist compatibele transceiver/FEC-modi |

| GPU Direct RDMA | ✓ Ja | Ondersteunde NVIDIA GPU-series |

| VMware vSphere / ESXi | ✓ Gecertificeerd | Native drivers, SR-IOV ondersteuning |

| Windows Server 2019/2022 | ✓ Ja | WinOF-2 driverpakket |

| Linux Kernel & OFED | ✓ Volledige ondersteuning | MLNX_OFED, inbox drivers |

- Bevestig de vereiste link-snelheid: voldoet 100Gb/s dual-port aan uw clusterbandbreedteplan? Overweeg voor 200Gb/s dual-port de -HDAT OPN.

- Verifieer server PCIe-slot: fysiek x16, Gen 3 of Gen 4 aanbevolen.

- Controleer kabeltype: QSFP56 passieve koperen (tot 5m) of actieve optische kabels voor langere afstanden.

- Zorg ervoor dat de besturingssysteemdrivers beschikbaar zijn (OFED, WinOF).

- Voor encryptievereisten: bevestig of ingebouwde block-encryptie nodig is – MCX653106A-ECAT ondersteunt AES-XTS, maar bevestig altijd het FIPS-niveau met het NVIDIA-datasheet.

- Evalueer virtualisatiebehoeften: SR-IOV, VXLAN offload, etc.