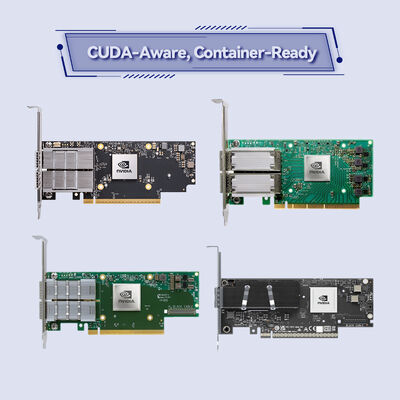

NVIDIA MCX555A-ECAT 100Gb/s Single-Port QSFP28 InfiniBand Adapter PCIe 3.0 x16 ConnectX-5 Netwerkkaart

Productdetails:

| Merknaam: | Mellanox |

| Modelnummer: | MCX555A-ECAT |

| Document: | CONNECTX-5 infiniband.pdf |

Betalen & Verzenden Algemene voorwaarden:

| Min. bestelaantal: | 1 stks |

|---|---|

| Prijs: | Negotiate |

| Verpakking Details: | Buitenste doos |

| Levertijd: | Op basis van inventarisatie |

| Betalingscondities: | T/T |

| Levering vermogen: | Levering door project/batch |

|

Gedetailleerde informatie |

|||

| Productenstatus: | Voorraad | Sollicitatie: | Server |

|---|---|---|---|

| Voorwaarde: | Nieuw en origineel | Type: | Bedraad |

| Maximale snelheid: | EDR en 100GBE | Ethernet -connector: | QSFP28 |

| Markeren: | NVIDIA ConnectX-5 InfiniBand adapter,100Gb/s QSFP28-netwerkkaart,PCIe 3.0 x16 Mellanox-kaart |

||

Productomschrijving

High-performance, low-latency 100Gb/s netwerkadapter ontworpen voor HPC, AI en cloud datacenters.en tagmatching voor MPI-werkbelastingen, waardoor de doorvoer en CPU-efficiëntie toonaangevend zijn in de industrie.

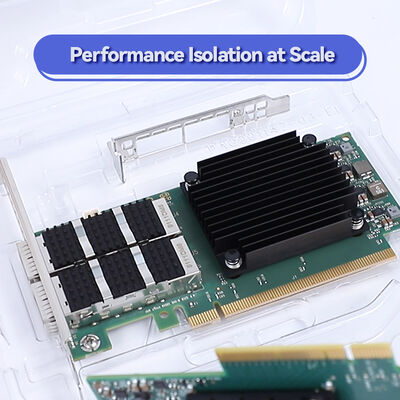

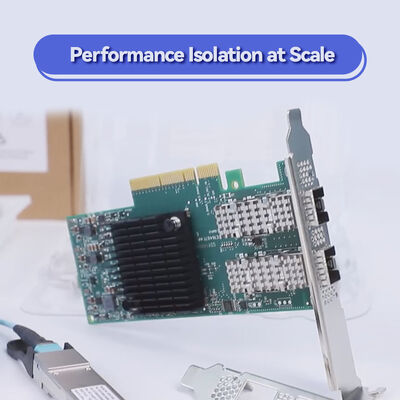

DeNVIDIA ConnectX-5 MCX555A-ECATis een enkele poort 100Gb/s InfiniBand adapter kaart in een low-profile PCIe-form factor.100 Gb/s doorvoerDe kaart ondersteunt zowel InfiniBand (tot EDR) als 100GbE, en biedt veelzijdige connectiviteit voor high-performance computing, opslag,en gevirtualiseerde omgeving.

Gebouwd met een ingebouwde PCIe-switch en geavanceerde RDMA-mogelijkheden, de MCX555A-ECAT offloads kritieke communicatie taken van de CPU lager stroomverbruikHet is volledig compatibel met PCIe 3.0 x16-slots en ondersteunt een breed scala aan besturingssystemen en versnellingsframeworks.

- Tot 100 Gb/sverbinding per poort (InfiniBand EDR / 100GbE)

- enkelvoudige QSFP28-connectormet een breedte van niet meer dan 50 mm,

- PCIe 3.0 x16-hostinterface(Auto-onderhandelingen naar x8, x4, x2, x1)

- RDMA, verzend/ontvang semantiekmet op hardware gebaseerd betrouwbaar transport

- Tagmatching en rendezvous van losladenvoor MPI en SHMEM

- NVMe over Fabrics (NVMe-oF) doelverlastenvoor efficiënte opslag

- GPUDirect RDMA (PeerDirect)versnelling voor GPU-communicatie

- Hardwaregebaseerde congestiebeheersing en adaptieve routingsupport

- SR-IOV virtualisatie:tot 512 virtuele functies

- RoHS-conform, laag profielvormfactor(met inbegrip van de lengte)

De ConnectX-5 architectuur integreert een reeks hardware versnelling motoren die CPU-interventie verminderen en de schaalbaarheid van de applicatie te verbeteren:

- MPI Tag Matching & Rendezvous Offload:Verlaadt berichtmatching en rendezvousprotocolverwerking, waardoor de MPI-prestaties voor HPC-clusters drastisch worden verbeterd.

- Out-of-Order RDMA met adaptieve routing:Het maakt efficiënt gebruik van meerdere netwerkpaden mogelijk, terwijl de semantiek van de geordende voltooiing wordt gehandhaafd, waardoor het gebruik van de stof wordt gemaksimaliseerd.

- NVMe-oF-doelontladingen:NVMe-opslagsystemen kunnen op afstand worden gebruikt met bijna nul CPU-overhead, ideaal voor gedesaggregeerde opslagarchitecturen.

- Dynamisch verbonden vervoer (DCT):Biedt extreme schaalbaarheid voor grote computersystemen en opslagsystemen door de overhead van verbindingsopstelling te elimineren.

- ASAP2 Versnelde schakeling en pakketverwerking:Hardware offload voor Open vSwitch (OVS) en overlay network tunneling (VXLAN, NVGRE, GENEVE).

- Paging op aanvraag (ODP):Ondersteunt virtuele geheugenpaging voor RDMA-operaties, waardoor applicatieontwikkeling wordt vereenvoudigd.

- High-Performance Computing (HPC):Ideaal voor supercomputingclusters, op MPI gebaseerde simulaties en wetenschappelijke onderzoekswerklasten die een lage latentie en hoge berichtpercentages vereisen.

- AI & Deep Learning-opleiding:Gecombineerd met GPUDirect RDMA, maakt het een snelle GPU-naar-GPU-communicatie tussen knooppunten mogelijk, waardoor de trainingstijden worden versneld.

- NVMe-oF-opslagsystemen:Invoer als opslagdoelen of initiatoren in NVMe over Fabrics-omgevingen voor toegang tot blokopslag met hoge doorvoer en lage latentie.

- Cloud en gevirtualiseerde datacenters:SR-IOV en virtualisatie-offloads ondersteunen multi-tenantomgevingen met gegarandeerde QoS en veilige isolatie.

- Hoogfrequentiehandel (HFT):Ultralage latentie en hardware-tijdstempels (IEEE 1588v2) voldoen aan de eisen van toepassingen voor financiële diensten.

De MCX555A-ECAT is ontworpen voor brede compatibiliteit met NVIDIA InfiniBand-switches (bijv. Quantum, Spectrum) en 100GbE-switches van derden.Het ondersteunt zowel passieve koperen DAC's als actieve optische kabels via QSFP28-poorten.

Besturingssystemen en software-stacks:

- RHEL / CentOS, Ubuntu, Windows Server, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, Platform MPI

- Data Plane Development Kit (DPDK) voor kernel bypass

| Parameter | Specificatie |

|---|---|

| Model | MCX555A-ECAT |

| Vormfactor | PCIe Low-Profile (14,2 cm x 6,9 cm zonder beugel), hoog beugel vooraf geïnstalleerd, kort beugel inbegrepen |

| Port snelheid en type | 1x QSFP28, tot 100Gb/s InfiniBand (EDR) en 100GbE |

| Host Interface | PCI Express 3.0 x16 (compatibel met x8, x4, x2, x1) |

| Ondersteuning van InfiniBand | IBTA 1.3-compatibel, 100Gb/s EDR, FDR, QDR, DDR, SDR; 8 virtuele lanes + VL15; 16 miljoen I/O-kanalen |

| Ondersteuning voor Ethernet | 100 GbE, 50 GbE, 40 GbE, 25 GbE, 10 GbE, 1 GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| RDMA-mogelijkheden | RDMA over Converged Ethernet (RoCE), hardware betrouwbaar transport, RDMA buiten orde, atoomoperaties |

| opslag en losladen | NVMe over Fabrics doellast, iSER, SRP, NFS RDMA, SMB Direct, overdracht van T10 DIF-handtekening |

| Virtualisatie | SR-IOV (maximaal 512 virtuele functies), VMware NetQueue, NPAR, PCIe Access Control Services (ACS) |

| CPU-afladen | TCP/UDP/IP stateless offload, LSO/LRO, checksum offload, RSS/TSS, VLAN/MPLS tag inbrengen/uittrekken |

| Overlappende netwerken | Hardware-afladen voor VXLAN-, NVGRE-, GENEVE-inkapseling/dekapseling |

| Beheer | NC-SI via MCTP, PLDM voor monitor/controle en firmware-update, I2C, SPI, JTAG |

| Afstandsstarten | Remote boot over InfiniBand, Ethernet, iSCSI; ondersteuning voor UEFI, PXE |

| Energieverbruik | Niet openbaar gespecificeerd; typisch bereik van minder dan 20 W ️ bevestig voor uw systeem |

| Werktemperatuur | 0°C tot 55°C (typische omgeving) |

| Naleving | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

Opmerking: specificaties afgeleid van NVIDIA ConnectX-5 productdocumentatie.

| Nummer van het bestelgedeelte | Ports / snelheid | Host Interface | Vormfactor | Belangrijkste kenmerken |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe met een laag profiel | Standaard single-port, EDR InfiniBand / 100GbE |

| MCX556A-ECAT | 2x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe met een laag profiel | Dual-port, EDR/100GbE |

| MCX556A-EDAT | 2x QSFP28, 100 Gb/s | PCIe 4.0 x16 | PCIe met een laag profiel | ConnectX-5 Ex, verbeterde PCIe Gen4 |

| MCX556M-ECAT-S25 | 2x QSFP28, 100 Gb/s | 2x PCIe 3.0 x8 | Socket Direct | Dual-socket serververbinding via harness |

| MCX545B-ECAN | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | OCP 2.0 type 1 | Open Compute Project vormfactor |

Voor OCP- of Multi-Host-varianten, neem dan contact op met de verkoop.

- Superieure toepassingsprestatiesHardware offloads voor MPI, NVMe-oF, en overlays vrije CPU-kernen voor zakelijke logica.

- Scalable RDMA-stof:DCT, XRC en out-of-order RDMA leveren lineaire schaalbaarheid voor duizenden knooppunten.

- GPU versnelling klaar:GPUDirect RDMA maakt directe geheugentoegang tussen GPU's en netwerkadapters mogelijk, waardoor CPU-flessknopen in AI-clusters worden geëlimineerd.

- Flexible inzet:Een enkele QSFP28-poort vereenvoudigt de bekabeling en is ideaal voor 100 Gb/s-architecturen.

- Bescherming van investeringen:Ondersteuning voor zowel InfiniBand als Ethernet maakt naadloze overgang tussen protocollen mogelijk naarmate de behoeften evolueren.

Hong Kong Starsurge Group biedt volledige levenscyclusondersteuning voor NVIDIA ConnectX-5-adapters, inclusief pre-sales configuratiehulp, firmware-updategids en garantie-service.Ons technisch team kan u helpen met:

- Verificatie van de compatibiliteit met uw server en switchinfrastructuur

- Performance-tuning voor HPC- of opslagwerkbelastingen

- Opties voor aangepaste behuizingen en vereisten voor bulkverpakkingen

- RMA-verwerking en geavanceerde vervangingsdiensten

Neem contact op met onze verkoopingenieurs voor de prijzen en de levertijden.

Elektrostatische ontlading (ESD):Gebruik altijd ESD-veilige praktijken bij het hanteren van de adapter.Verkoelingseisen:Zorg voor een voldoende luchtstroom in het chassis van de server om de werktemperatuur binnen het gespecificeerde bereik te houden.Firmware-updates:Gebruik NVIDIA officiële firmware tools (MFT) en controleer de compatibiliteit met uw besturingssysteem en stuurprogramma versie voordat u bijwerkt.Kabelbuigwerk:Volgt de richtlijnen voor de straal van de QSFP28-kabel om signaldegradatie te voorkomen.

Dit is een product van klasse A. In een woonomgeving kan het radio-interferentie veroorzaken.

Opgericht in 2008,Hong Kong Starsurge Group Co., Limitedis een technologiegerichte leverancier van netwerkhardware, IT-diensten en systeemintegratieoplossingen.controllersStarsurge combineert diepgaande technische expertise met een klantgerichte aanpak.,Het bedrijf biedt IoT-oplossingen, netwerkbeheersystemen, maatwerksoftwareontwikkeling en meertalige wereldwijde levering.Starsurge helpt klanten om efficiënt te bouwen, schaalbare en betrouwbare netwerkinfrastructuur.

| Component / systeem | Standaard van verenigbaarheid | Notities |

|---|---|---|

| NVIDIA Quantum InfiniBand-schakelaars | Gecertificeerd | EDR- en HDR-compatibiliteit bij gebruik van geschikte firmware |

| NVIDIA Spectrum Ethernet-switches | Gecertificeerd | Ondersteunde standen 100GbE, 50GbE, 25GbE |

| 100GbE-switches van derden | Compatibel | Vereist naleving van IEEE-normen; getest bij grote leveranciers |

| GPU-servers (NVIDIA DGX, HGX) | Gecertificeerd met GPUDirect | RDMA-versnelling voor multi-GPU-communicatie |

| Storage-arrays met NVMe-oF | Ondersteund | Doelontlading maakt efficiënte NVMe-stoftoegang mogelijk |

- Bevestig dat de server beschikt over een PCIe 3.0 x16 (of x8) slot met voldoende ruimte.

- ¢ Bepaal het aantal poorten: enkelvoudige (MCX555A-ECAT) versus dubbelvoudige (MCX556A-ECAT).

- ¢ Kies het type kabel: passief koperen DAC voor korte afstanden (≤5m) of optisch voor langere afstanden.

- ¢ Bevestig de ondersteuning van het besturingssysteem en de stuurprogramma's (OFED, Windows, VMware).

- Voor GPU-clusters moet u ervoor zorgen dat GPUDirect RDMA compatibel is met uw GPU-model en stuurprogramma-versie.

- Controleer of er een hoge of een korte beugel nodig is voor het chassis van uw server.

- NVIDIA MCX556A-ECAT Dual-port 100Gb/s ConnectX-5 adapter

- NVIDIA MCX556A-EDAT ️ ConnectX-5 Ex met ondersteuning voor PCIe 4.0

- NVIDIA Quantum-2 QM9700 40-poort 800Gb/s InfiniBand Switch

- Mellanox QSFP28 passieve DAC-kabels (1m, 2m, 3m)

- NVIDIA Spectrum-4 SN5600 100GbE/400GbE Ethernet-switches

- NVIDIA ConnectX-5 InfiniBand Adapter Card Gebruikershandleiding

- RDMA over Converged Ethernet (RoCE) Implementatiegids

- GPUDirect RDMA Best Practices voor AI-clusters

- NVMe over Fabrics met ConnectX-5

- OFED Installatie- en tuninggids